フェイストラッキングしてLive2Dモデルを動かそう!【Mac版】|東京のWEB制作会社・ホームページ制作会社|株式会社GIG

BLOG

ブログ

フェイストラッキングしてLive2Dモデルを動かそう!【Mac版】

2022-04-15 制作・開発

こんにちは、GIGでバックエンドエンジニアをしている庄子です。

私は普段、バーチャルYouTuberの動画ばかり見ているのですが、フェイストラッキングやモーションキャプチャーの技術に驚かされることばかりです。

しかし、ITエンジニアの端くれならば、その仕組みぐらいは知っておかないといけないと思い、今回はLive2Dを使用したフェイストラッキングを実際に行ってみました。

Live2Dとは

早速ですが、Live2Dとはいったい何でしょうか。

Live2Dは、株式会社Live2D(旧: 株式会社サイバーノイズ)が開発した、2Dのモーフィングによるシームレスアニメーションを可能にする映像表現と、その関連ソフトウェアの総称です。

簡単に言うと、2Dの絵を動いて見えるようにする技術ってことですね。『放置少女』や『バンドリ』といったゲームでも使用されているので、みなさんも一度は見たことがあると思います。また、最近ではバーチャルYouTuberがライブ配信をするために、Live2Dを使用することがあります。

なお、Live2Dモデルを動かすには、フェイストラッキングソフトウェア(顔の表情を認識、追跡するソフト)が必要です。環境やPCスペック、持っている端末の種類によって使用するソフトウェアが変わってくるので、状況に応じて選択していきましょう!

フェイストラッキングソフトウェアの種類

フェイストラッキングソフトウェアの中で一番使われているのは『Animaze by FaceRig』です。使っている人が多く、トラッキングの精度が高いと言われています。ただし、こちらはWindows専用のソフトになります。私はMacを愛用しているので、今回はMacでも使用できるフェイストラッキングソフトウェアを紹介していきます。

Macに対応しているソフトは、おもに以下の2つになります。

- 3tene

3teneにはFREE、PRO、STUDIOの3種類のプランがあり、Live2Dを動かすためにはPRO以上のソフトが必要です。PROの場合は2,750円で購入することができます。 - VTube Studio

PCのWebカメラを使用することで、無料でLive2Dモデルを操作することができます。無料版の場合は左下にキャラクターが浮遊し続けますが、1,520円の課金によって、それを消す事ができます。

iOSやAndroidと連携して使う場合は、有料アプリの購入が必要です。有料アプリはiOS版が2,820円、Android版が1,580円となっていて、iOSの「ARKit」やAndroidの「ARCore」を使用することで高精度なトラッキングができます。

今回は、無料で始められるVTube Studioについて解説します。

VTube Studioの使い方

VTube Studioは、ゲームプラットフォームの『steam』からインストールすることができます。VTube Studioを起動すると、このような画面が表示されます。

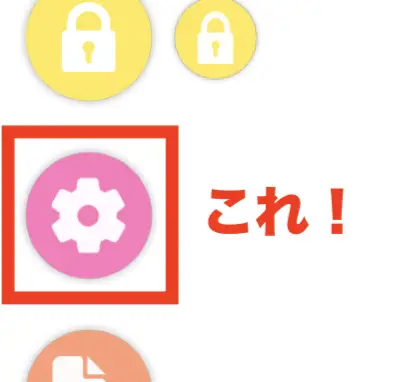

このままだと、Webカメラが認識してくれないので、Webカメラの設定をしてあげましょう。画面左のメニューから歯車を押してください。

設定メニューが開いたら、左上にあるアイコンメニューの左から二番目のカメラアイコンを選んでください。

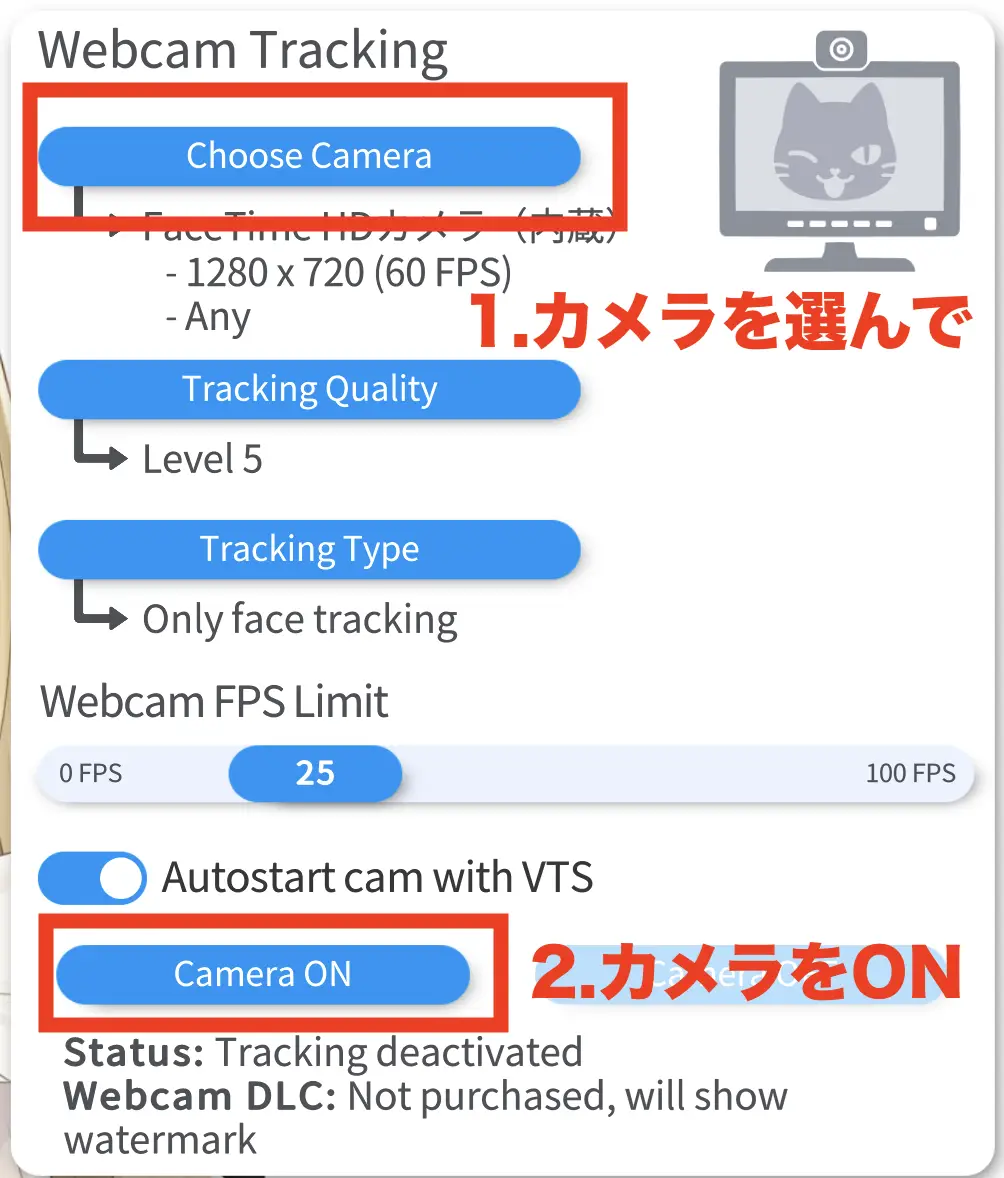

Webcam Tracking設定から、カメラを選んで、カメラをONにすると、トラッキングが開始されます。

これで、あなたもバーチャルの姿を手に入れることができました。実際に動かしてみましょう!

Webカメラに写っている自分の体を認識して、キャラクターが左右に動いてくれたり、まばたきを認識すると、キャラクターもまばたきをしてくれたりします。また、口の動きもある程度リアルタイムでリップシンクしてくれてます。

上記で紹介しているiOS/Androidを使用したトラッキングを行うと、より認識精度を高めることができますよ。

バーチャル姿でWeb会議に出よう!

VTube Studioでバーチャルの姿をゲットすることができました。せっかくなので、この姿でWeb会議に出る方法も合わせて紹介したいと思います。

バーチャル姿でWeb会議に出るためには、『OBS Studio(Open Broadcaster Software Studio、以下OBS)』というソフトウェアが必要。OBSは主にPCで動画配信を行うときに使うソフトウェアで、使用料は無料です。OBSをダウンロードしてみましょう。

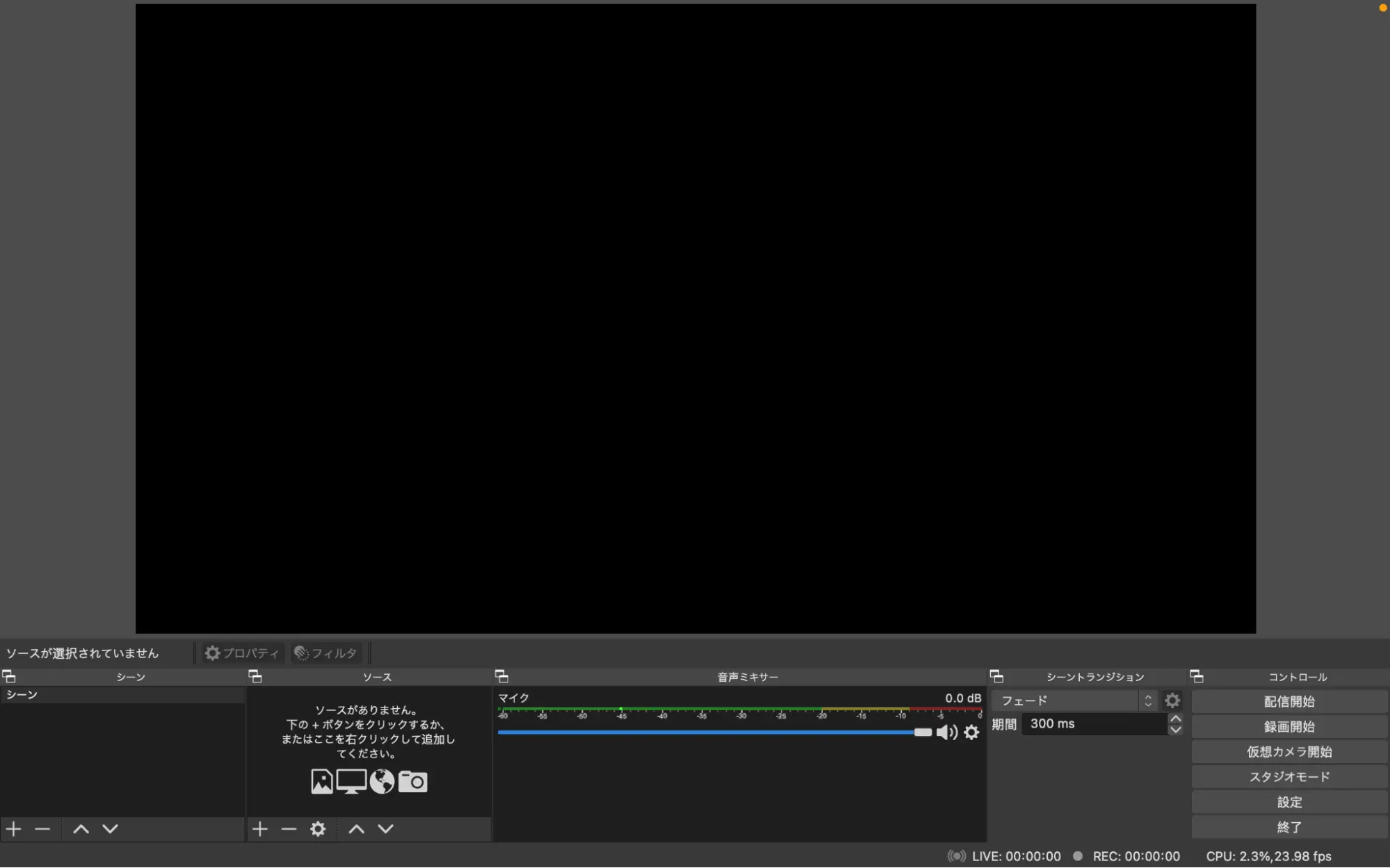

OBSを起動するとこのような画面になります。

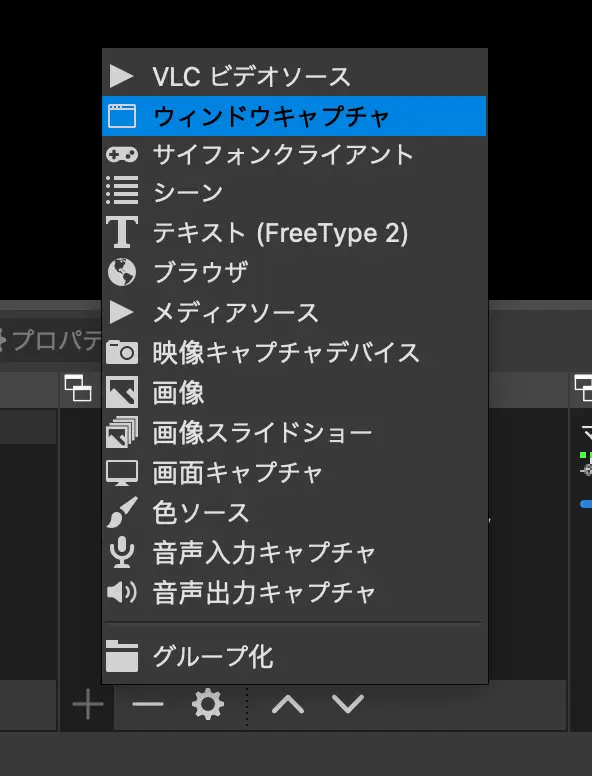

上部にある黒い領域が、配信するときに表示される部分です。VTube Studioの画面をキャプチャするために、ソースの追加を行います。まずはソースウィンドウの+を押してウィンドウキャプチャを選択します。

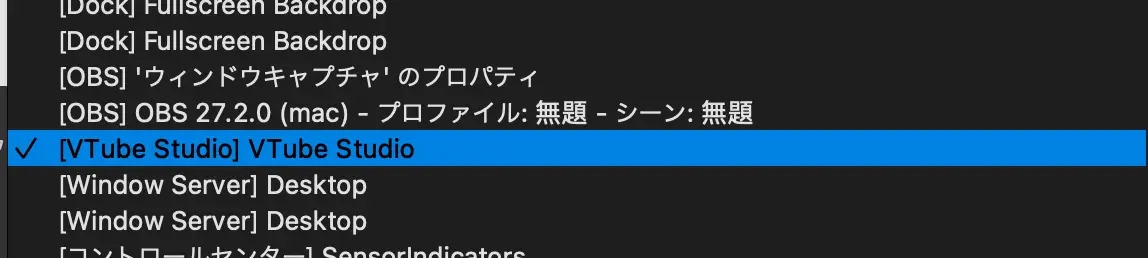

ウィンドウキャプチャを選び、「VTube Studio」を選択します。

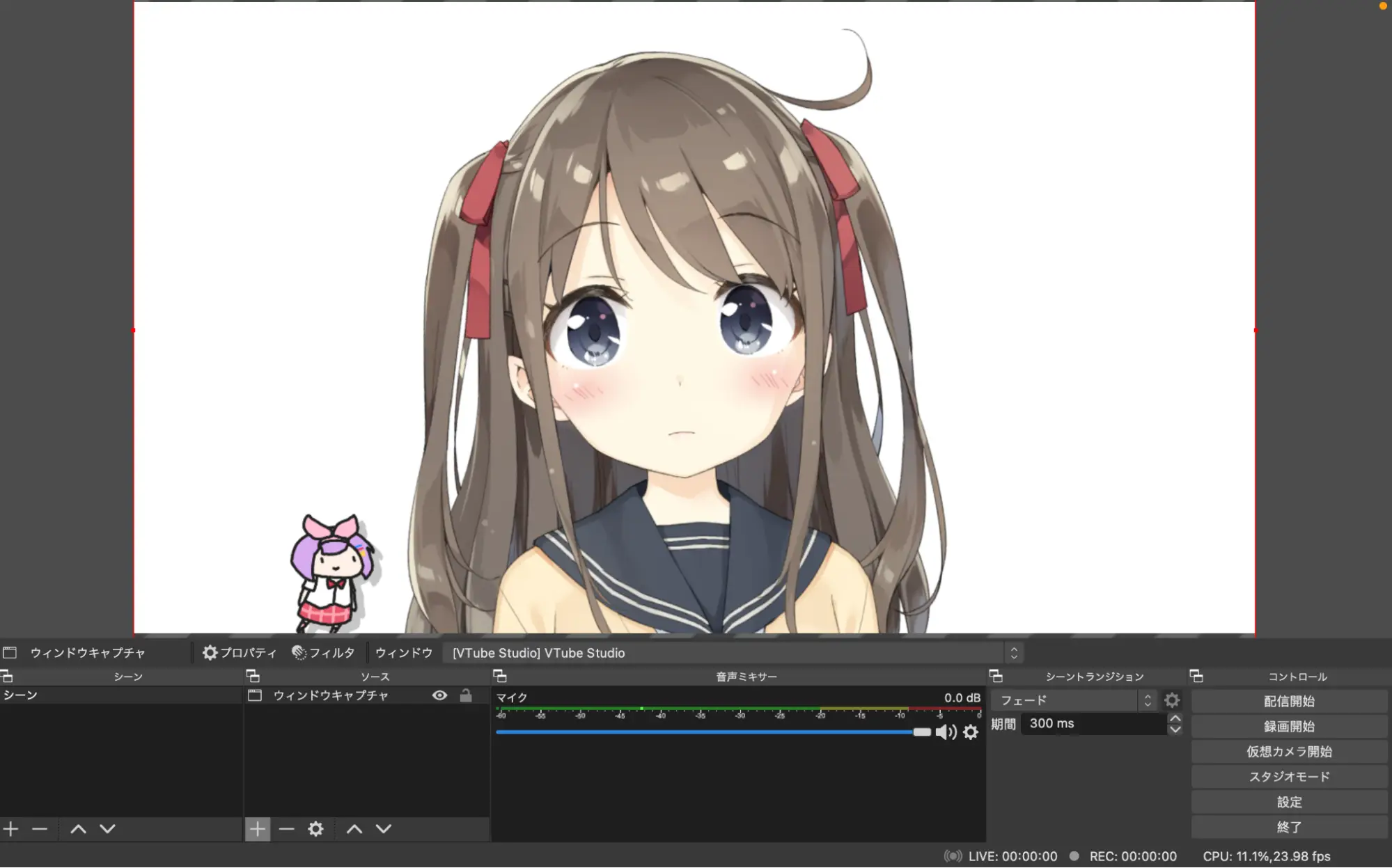

VTube Studioを選択すると、VTubeStudioの画面がOBS上に展開するので、赤枠内に画面を収めます。

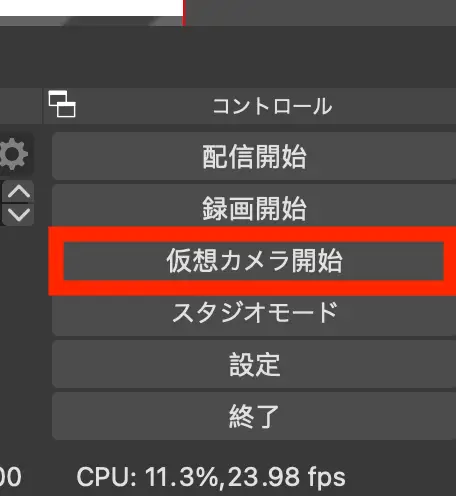

続いては、仮想カメラを起動します。起動すると赤枠内(該当画像上部)がカメラに映し出されている状態になります。仮想カメラの起動は画面右下にあるコントロールから選択します。

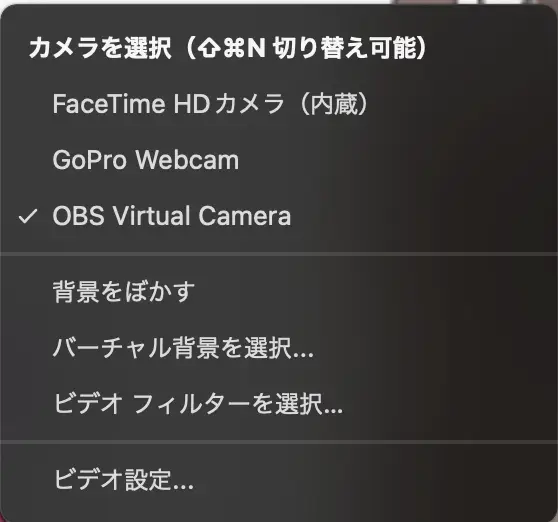

これでOBSの画面が仮想カメラとして認識されるので、ZOOM等のカメラ設定で「OBS Virtual Camera」を選択すると、相手にバーチャルの姿を表示することができます!

これで設定は完了です。バーチャル姿でWeb会議に出ることができます。

おまけ:Macで使えるボイスチェンジャー

おまけとして、Macでボイスチェンジャーをする場合のおすすめソフトウェアを紹介します。

『Gachikoe! 』というソフトです。遅延せず、高品質なピッチとフォルマントの調整を行うことができます。このソフトウェアはWindows、Macどちらにも対応しており、無料版と有料版がありますが、どちらも機能は同じです。

もちろん、声質やどんな声になりたいかによって、調整する値は異なってくるのですが、私の場合は裏声で話し続けるのが辛いので、地声の高いところをキープしつつ、ピッチが200、フォルマントを150ほどにして話すと、自然な声に聞こえるようになりました。

テストで同僚の方に聞いて貰う機会があったのですが、「かなり女性の声に聞こえるけど、本人を知っているから、めちゃめちゃ違和感を感じる」という評価でした。もっと精進していきますね!

まとめ

私は普段Webサービス開発を行っているので、実務で活かせる機会はまだありません。ですが、可能性を広めるといった点では、普段触れていない技術を体験するということは大切だなと思いました。

みなさまも、ぜひバーチャルの世界に飛び込んでみてはいかがしょうか?

なお株式会社GIGは、ナショナルクライアントからスタートアップまで、Webコンサルティング、UI/UXデザイン、システム開発など、DX支援をおこなうデジタルコンサルティング企業です。45,000人以上が登録するフリーランス・副業向けマッチングサービス『Workship』や、7,000人以上が登録するデザイナー特化エージェントサービス『クロスデザイナー』、リード獲得に必要な機能を備えたCMS『LeadGrid』、UXコンサルティングサービス『UX Design Lab』などを展開しています。

WebやDX支援のご相談はいつでもご連絡ください!

■株式会社GIG

お仕事のお問い合わせはこちら

会社紹介資料のダウンロードはこちら

採用応募はこちら(GIG採用サイト)

採用応募はこちら(Wantedly)

WebやDXの課題、無料コンサル受付中!

庄子肇

バックエンドエンジニア。宮城大学事業構想学部デザイン情報学科を卒業後、ベンチャー企業でエンジニアとして常駐先のシステム開発やサイト制作の経験を積んだ後、2019年10月にGIGにジョイン。